~ AIは「有能な秘書」か、「お喋りなスパイ」か?~

「ChatGPTは情報漏洩のリスクがあるから、当社のネットワークからはアクセス禁止にしています」

もしあなたの会社がこのような「全面禁止令」を出しているなら、残念ながらその対策はすでに破綻している可能性が高いでしょう。

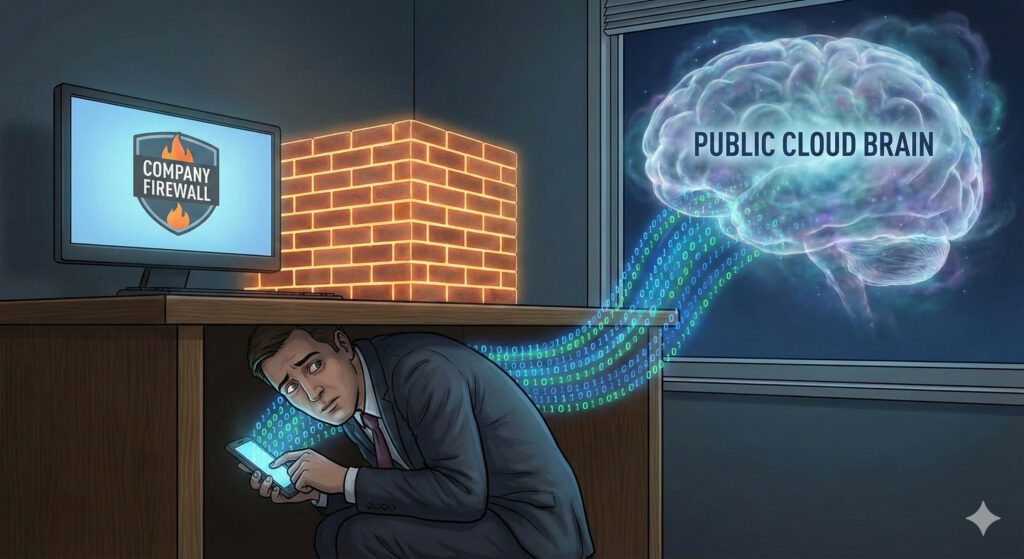

社員は、会社のPCで使えないなら、個人のスマホでChatGPTを開き、業務上のメールやコードをコピペして「要約して」「バグを見つけて」と入力しているからです。これが「Shadow AI(シャドーAI)」の実態です。

AIは業務効率を劇的に上げる「有能な秘書」ですが、使い方を誤れば、入力した機密情報を学習し、世界の誰かへの回答としてペラペラと喋ってしまう「スパイ」にもなり得ます。

本稿では、生成AIが生み出す新たなリスク(Shadow AI、AIフィッシング)と、それを「禁止」ではなく「技術」で制御するための、ゼロトラスト時代のAI活用戦略を解説します。

1. 「Shadow AI」を制御する:DLPと法人版契約

「禁止」すればするほど、地下に潜る

Vol.11(UX編)でも触れましたが、便利なツールを一方的に取り上げることは不可能です。社員が隠れて(個人のアカウントで)使い始めた瞬間、企業はデータのコントロールを完全に失います。

特に無料版の生成AIサービスの多くは、規約上「入力データをモデルの学習に利用する」と明記されています。あなたの会社の顧客リストや新製品の仕様書が、AIの知識の一部になってしまうのです。

「安全なガス抜き」を用意せよ

対策はシンプルです。「会社が契約した、学習されない安全な環境」を提供することです。

- 法人版の契約:

「ChatGPT Enterprise」や「Copilot for Microsoft 365」など、入力データが学習に利用されない(オプトアウトされた)環境を契約し、全社員に開放してください。 - DLP(データ損失防止):

その上で、WebフィルタリングやEDRの機能を使い、個人のAIサービスへのアクセスをブロックするか、「機密情報の貼り付け」だけを検知・遮断する設定を行います。

「会社のAIを使ったほうが安全で便利」という状態を作ることが、唯一のShadow AI対策です。

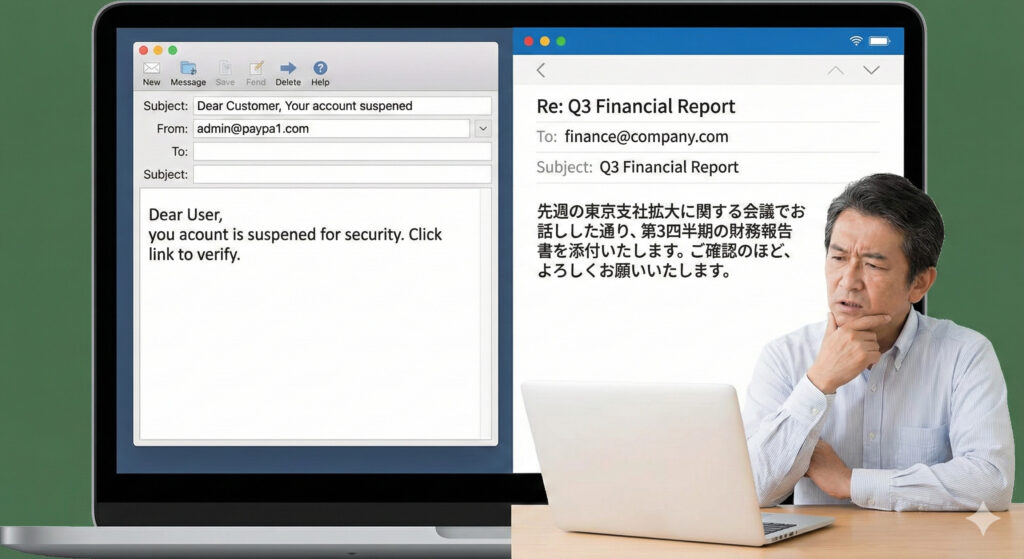

2. 「怪しい日本語」はもう来ない:AIフィッシングの脅威

セキュリティ教育の限界

これまでのセキュリティ教育では、「怪しい日本語や、不自然な文脈のメールに注意しましょう」と教えてきました。しかし、AIの登場でその見分け方は通用しなくなりました。

攻撃者は生成AIを使い、完璧なビジネス日本語で、しかもターゲットの業界用語や、過去の漏洩メールから学習した「文脈(コンテキスト)」に沿ったフィッシングメールを一瞬で作成します。

さらに、CEOの声色を学習させたAIによる「ディープフェイク音声」を使った詐欺(CEO詐欺)も現実のものとなっています。

もはや、「人間の注意深さ」だけで攻撃を見抜くことは不可能です。社員を責めるのはやめましょう。

3. 「AIにはAIを」:防御側の進化(Security Copilot)

ログ分析をAIに任せる

攻撃者がAIを使うなら、防御側もAIを使わなければ勝ち目はありません。

Vol.8で「ログ監視」の重要性を説きましたが、膨大なログを人間がすべて見るのは限界があります。ここで「防御用AI(Security Copilotなど)」の出番です。

最新のセキュリティ運用では、SIEMに集まった大量のログをAIが分析し、「このPowerShellコマンドは、過去のランサムウェア攻撃と特徴が似ている」といった洞察を自然言語で提示してくれます。

「AI vs AI」の戦いは、すでに始まっています。

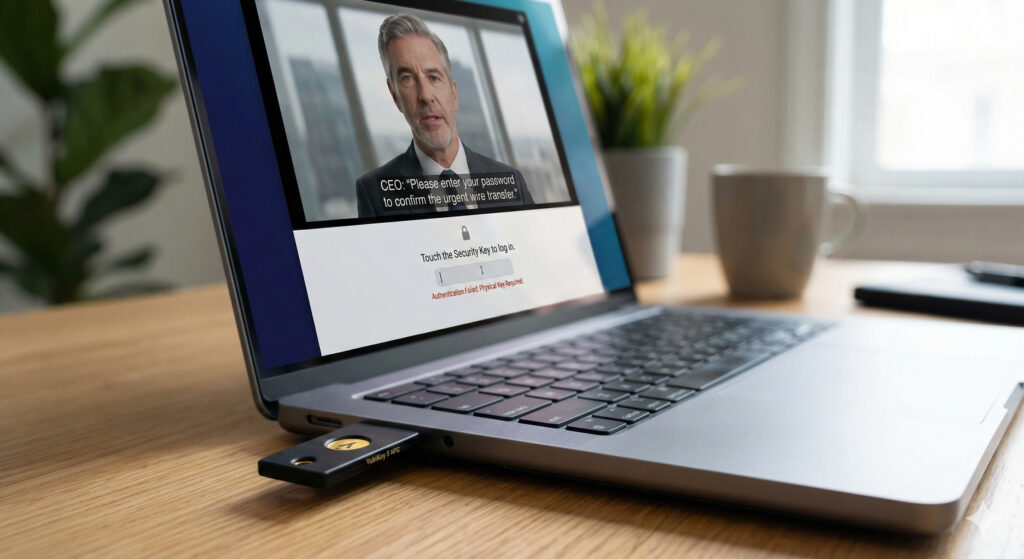

4. 結局、最後に頼れるのは「FIDO2」である

原点回帰:物理的な「鍵」を持つ

どんなにメールが巧妙でも、どんなに電話の声が社長そっくりでも、攻撃者が絶対に突破できない壁があります。

それが、Vol.4で導入した「FIDO2(物理セキュリティキーや生体認証)」です。

もし社員がAIフィッシングに騙され、偽のログインサイトに誘導されたとします。IDとパスワードを入力してしまったとしても、FIDO2認証が導入されていれば、攻撃者はログインできません。なぜなら、「社員が持っている物理キー(またはスマホ)」を、攻撃者は持っていないからです。

AIの「騙す能力」がいかに進化しても、物理的なデバイス認証(所持認証)を突破することはできません。

これが、ゼロトラストにおいてFIDO2が「最後の砦」と呼ばれる理由です。

結論:AIを恐れず、AIで守れ

生成AIは、セキュリティのリスクであると同時に、私たちの業務を助ける強力な武器でもあります。

漠然とした不安から「禁止」に逃げるのではなく、以下の3ステップで向き合ってください。

- 環境整備: 入力データが学習されない「法人版AI」を契約し、Shadow AIを防ぐ。

- 防御の自動化: ログ分析や検知にAIを取り入れ、人間の認知限界を補う。

- 認証の強化: AIでも騙せない「FIDO2認証」を徹底し、人のミスをカバーする。

AI時代のセキュリティは、「人を信じない(Zero Trust)」からこそ、逆に「人が安心してAIを使える」環境を作ることができるのです。